Millones de estadounidenses conversan a diario con chatbots de IA. Hablamos con máquinas sobre planes de viaje, política y, en algunos casos, sobre nuestros pensamientos más íntimos.

Para investigar cómo estas conversaciones con IA pueden afectar nuestra salud mental colectiva, NBC New York colaboró con dos de las organizaciones de salud mental más importantes de América del Norte, que representan a miles de psiquiatras y consejeros profesionales.

En un par de encuestas exclusivas, más de 2000 miembros de la Asociación Estadounidense de Psiquiatría (APA) y más de 770 miembros de la Asociación Estadounidense de Consejería (ACA) evaluaron los riesgos y beneficios de los chatbots de IA.

Las respuestas revelan profundas preocupaciones sobre el uso acelerado de chatbots de IA en la sociedad y los riesgos de delirios o dependencias malsanas que podrían desarrollarse cuando las personas vulnerables tienen relaciones con máquinas que imitan la conversación humana.

“Se han hecho públicos varios casos de personas que se han vuelto demasiado adictas a los chatbots”, afirmó la Dra. Marketa Wills, directora ejecutiva de la APA. “A medida que hemos visto surgir estas adicciones a la IA y los chatbots, como sector, nos instamos a ser más cautelosos”.

Olivia Uwamahoro, quien copreside el Grupo de Trabajo sobre IA de la ACA, dijo que cientos de sus colegas consejeros participaron en la encuesta porque ven que los pacientes de salud mental usan chatbots con mayor frecuencia.

«Existe una preocupación inicial: si nos volvemos demasiado dependientes de esta tecnología tan compleja, ¿qué impacto podría tener en nuestro bienestar general?», dijo.

Psiquiatras y consejeros pesimistas sobre la IA

Según los resultados de las dos encuestas, la mitad de los psiquiatras encuestados cree que el uso de IA en la sociedad tenderá a disminuir nuestra salud mental colectiva, mientras que el 24% pronostica que la IA aumentaría la salud mental.

Los consejeros que respondieron fueron aún más pesimistas: el 71 % predijo que la IA tendería a disminuir la salud mental colectiva y solo el 16 % dijo que la IA sería un beneficio general para la salud mental.

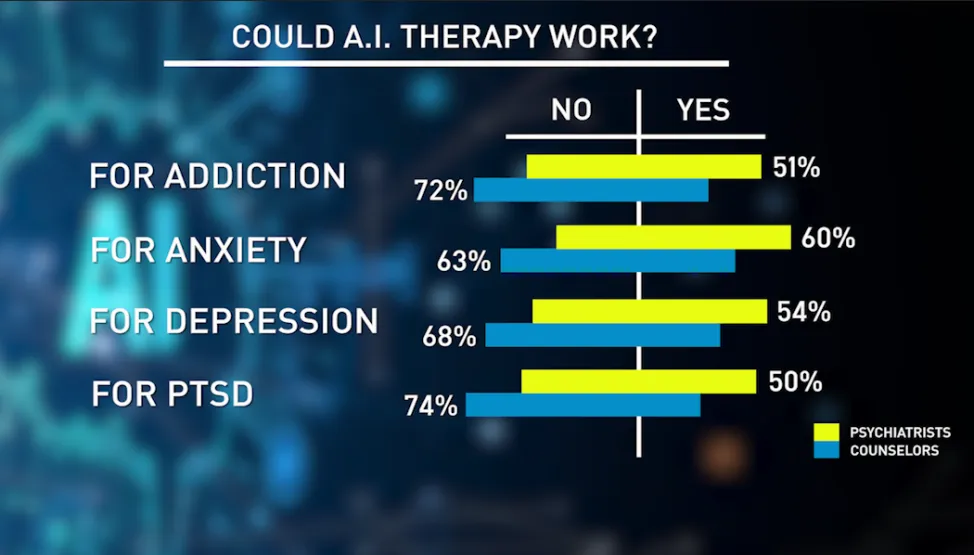

En cada encuesta, también se pidió a los encuestados que consideraran si las plataformas de IA, diseñadas específicamente para la salud mental, podrían usarse de manera efectiva para ayudar a abordar afecciones como la ansiedad, la depresión y la adicción.

En estas preguntas, los profesionales de la salud mental mostraron mayor división: aproximadamente dos tercios de los consejeros estaban convencidos de que los «bots terapéuticos» de IA serían ineficaces. Los psiquiatras mostraron una división más equitativa, con una escasa mayoría que expresó optimismo sobre la eficacia de la terapia con IA, especialmente para la ansiedad.

Los desarrolladores de IA se resisten

Aunque los encuestados mostraron diferencias respecto a la eficacia de las aplicaciones de IA para la salud mental, los desarrolladores tecnológicos argumentan que los chatbots ya están ayudando a personas que luchan contra la soledad, el mal humor y la tristeza, incluso si las plataformas de IA no llegan a ser una terapia completa. También afirman que los modelos de lenguaje a gran escala tienen un gran potencial para subsanar las frustrantes carencias en el acceso a los servicios de salud mental.

«Creo que la IA tiene el potencial de mejorar significativamente la salud mental de la población de una manera que no hemos visto en nuestra vida», dijo Jenna Glover, directora clínica de Headspace, una empresa que diseñó un chatbot llamado «Ebb», que se promociona como «un compañero empático de IA».

Glover afirma que «Ebb» opera en el ámbito del bienestar y enfatizó que el chatbot no ofrece terapia. Más bien, explica, ofrece a las personas un espacio seguro para hablar sobre sus problemas diarios de salud mental, a la vez que les indica estrategias probadas para afrontarlos, como ejercicios de respiración, llevar un diario y yoga.

“Descubrir que existía algo con lo que podía hablar, que me respondía y me hacía reflexionar y profundizar en lo que sentía y por qué me sentía así, sin culpar a nadie más. Fue un cambio de vida”, dijo Nicole Walker, usuaria de Headspace que se conecta a Ebb para calmar su ansiedad cuando su mente empieza a acelerarse. Walker comentó que le diagnosticaron trastorno límite de la personalidad cuando era más joven.

Escasa evidencia clínica

El Dr. John Torous, psiquiatra de Harvard y miembro de la Asociación Estadounidense de Psiquiatría, dijo que cree que los chatbots de IA algún día podrían servir como herramientas efectivas de salud mental, pero dijo que los desarrolladores de IA deben hacer más para compartir datos con los investigadores y validar resultados positivos.

“Estas son máquinas de imitación increíbles. Pueden imitar a un terapeuta. Pueden imitar a un psiquiatra”, dijo Torous. “Si vamos a permitir que la IA tenga un papel más importante en la salud mental, lo haremos porque confiamos en ella. Y si vamos a confiar en las empresas que la respaldan, tendrán que esforzarse mucho para demostrarnos que son seguras y eficaces”.

En noviembre pasado, Torous testificó ante un subcomité del Congreso que “no existe ninguna investigación bien diseñada, revisada por pares y replicada que demuestre que cualquier chatbot de IA que haga afirmaciones sobre salud mental sea eficaz para mejorar significativamente los resultados clínicos”.

Torous también expresó su preocupación por el hecho de que algunos chatbots de IA utilizan terminología terapéutica en su lenguaje de marketing, solo para desautorizar el uso de la terapia en la letra pequeña legal.

“Tenemos una especie de Viejo Oeste donde todo el mundo publica un chatbot cada semana y dice: ‘Mi chatbot es lo mejor para la salud mental. ¡Vengan a usarlo!’. Y muchos de estos presentan serios problemas de seguridad”, dijo.

El sitio web de Youper.ai, una aplicación de salud mental, afirma que el chatbot «utiliza la Terapia Cognitivo-Conductual (TCC), la forma más eficaz de mejorar la salud mental». Sin embargo, casi al final de las Condiciones de Uso de la empresa, hay una cláusula que indica que los chatbots de Youper «NO ESTÁN DESTINADOS A PROPORCIONAR PSICOTERAPIA O ASESORAMIENTO CLÍNICO».

El Dr. Jose Hamilton, director ejecutivo de Youper, dijo que la referencia a la terapia cognitivo-conductual significa que su chatbot está entrenado en TCC, no que el chatbot brinde o realice algún tipo de psicoterapia.

“El chatbot te ayuda a practicar técnicas que mejorarán tus emociones, tus pensamientos y tus comportamientos”, dijo.

En las encuestas de APA y ACA, más de dos tercios de los encuestados dijeron que las aplicaciones de terapia o salud mental basadas en IA deberían estar obligadas a obtener la aprobación de la FDA.

Más de tres cuartas partes de los psiquiatras y consejeros encuestados dijeron que el gobierno debería exigir ensayos clínicos aleatorios para evaluar las aplicaciones de salud mental basadas en IA.

El sitio web de Youper cuenta con un estudio de la Universidad de Stanford que, según afirma, encontró reducciones significativas en los síntomas de ansiedad y depresión entre los usuarios del chatbot.

Pero los autores del estudio revelaron que su investigación implicó un análisis de datos de descarga de aplicaciones sin participantes humanos. Otro estudio citado en el sitio web de Youper analizó cómo los usuarios califican el chatbot sin compararlo con un grupo de control.

“No fueron ensayos clínicos aleatorizados”, dijo el Dr. Hamilton. “Ese es el criterio de referencia, pero existen niveles de evidencia. Y los ensayos clínicos aleatorizados no son necesariamente la única evidencia”.

La primavera pasada, investigadores de la Universidad de Dartmouth publicaron un estudio controlado aleatorio que examinaba un chatbot de salud mental llamado «Therabot». Los autores del estudio informaron resultados que describieron como «muy prometedores», incluyendo una reducción del 51 % en los síntomas de depresión y del 31 % en los de ansiedad.

Fuente: Chris Glorioso / nbcnewyork.com